حذر تقرير لصحيفة "الجارديان" البريطانية من "الأخبار المزيفة" مستقبلاً، لاسيما مع ازدهار وسائل التواصل الاجتماعى وبرامج الفوتوشوب.

وقالت إن هناك أدوات جديدة يمكن استخدامها للتلاعب فى الصوت وشكل الأشخاص فى الفيديوهات، وذلك بفضل التقدم فى مجال الذكاء الاصطناعى ورسومات الكومبيوترات، وأوضحت أن هذه الأدوات من شأنها أن تسمح بمحاكاة صوت شخصيات عامة وتقليدها، فيمكن أن يرى فيديو يعلن فيه الرئيس الأمريكى دونالد ترامب بميله للرياضات المائية، وآخر تظهر فيه هيلارى كلينتون تصف فيه الأطفال المسروقين، وثالث يكشف فيه توم كروز عن أدق أسراره.

وكشفت الصحيفة عن أن هناك فرقا بحثية عديدة تعمل على التقاط وتوليف عناصر بصرية وصوتية مختلفة للسلوك البشرى.

وأضافت أن هناك برمجيات تم تطويرها في جامعة ستانفورد قادرة على التلاعب بلقطات الفيديو تظهر فيها الشخصيات العامة إذ تسمح لشخص آخر بقول الكلمات لكن تظهر الشخصية العامة وهى تقولها بصوتها.

ويمكن لأى شخص يستخدم هذا البرنامج أن يقوم بتعبيرات وجه مثل فتح الفم أو إغماض العين فيظهر وكأن الشخصية العامة هى من تقوم بهذه التعبيرات.

ورغم أن برمجيات "Face2Face" ممتعة كلعبة يمكن استخدامها فى السخرية من الشخصيات العامة، إلا أنها يمكن أن تكون خطيرة لاسيما فى ظل مساعدة وسائل التواصل الاجتماعى على نشر الأخبار وقت حدوثها.

ويقول نيتش ساكسينا، الأستاذ المساعد ومدير الأبحاث فى جامعة ألاباما فى قسم برمنجهام علوم الحاسب الآلى إن استخدام هذه البرمجيات فى الأخبار المزيفة، له آثار أخطر، إذ "يمكن ترك رسائل صوتية وهمية مثلا من أم أو أب لابنائهم، كما يمكن استخدامها فى تشويه سمعة شخص ما ونشر عينات الصوت عبر الإنترنت. "

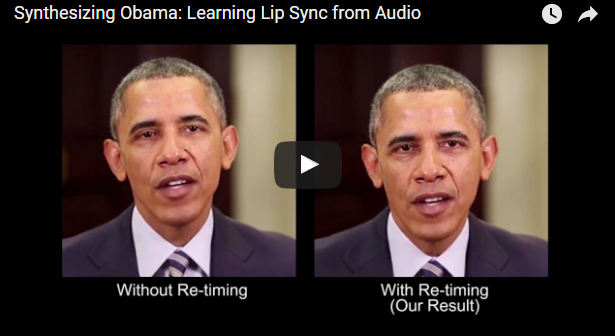

تقليد أوباما

ولكن لحسن الحظ، لا تزال هذه التقنيات بعيدة عن المثالية، فتعبيرات الوجه تبدو في أشرطة الفيديو مشوهة أو غير طبيعية قليلا، كما تبدو الأصوات روبوتية قليلا.

ولكن مع الوقت، سوف يتمكن القائمون على هذه البرمجيات من تقليد الصوت بشكل كامل وكذلك مظهر الشخص بدرجة قد يكون من الصعب للغاية على البشر كشفها أو تخيل أنها مخادعة.

ومع تراجع الثقة فى وسائل الإعلام وانتشار الأخبار الكاذبة عبر وسائل التواصل الاجتماعى، سيصبح لزاما على المؤسسات الإخبارية أن تدقق في المحتوى الإخبارى سواء فى الأخبار المكتوبة أو المسموعة أو المرئية.

وأضافت "الجارديان" أنه ستكون هناك علامات تفيد بمكان تصوير الفيديو أو التسجيل الصوتى، مثل مطابقة الظروف الجوية للتسجيلات فى ذلك اليوم.

وتقول ماندى جينكينز، من شركة "ستوريفول" الإخبارية الاجتماعية، وهى شركة متخصصة فى التحقق من المحتوى الإخبارى، إن الناس يجب أن ينظروا أيضا إلى الإضاءة والظل في الفيديو، وما إذا كانت جميع العناصر الواردة في الإطار فى حجمها الصحيح، وما إذا كان الصوت متزامنا تماما كما يجب مع شفاه المتحدث.

ورغم أن صلات التحرير بإمكانها منع نشر أى محتوى بتدقيقها الصارم، إلا أن نشر الفيديوهات أو التسجيلات على وسائل التواصل الاجتماعى من شأنه أن ينتشر كالفيروس، وأن يؤدى إلى كوارث سياسية أو دبلوماسية أو حتى فى العلاقات العامة، فمثلا يمكن تخيل انتشار فيديو لترامب يعلن فيه الحرب على كوريا الشمالية على سبيل المثال.

وتقول: "إذا كان شخص ما يبدو مثل ترامب ويتحدث مثل ترامب فسوف يعتقد الناس أنه ترامب، وأضافت جينكينز أنه لا يوجد صعوبة الآن فى نشر فيديوهات أو تسجيلات غير حقيقية "وهذا(البرمجيات) سيجعل الأمر أسوأ "